Na tym obrazie poniżej widać że nie można przesadzać z kompresją - utrata obrazu w pewnym momencie stanie się zbyt zauważalna.

Na tym obrazie poniżej widać że nie można przesadzać z kompresją - utrata obrazu w pewnym momencie stanie się zbyt zauważalna.

Dostaniesz dwa różne efekty, dla całego obrazka rozmycie zwiększy objętość, a dla skadrowanego rozmycie zmniejszy objętość.

Bez kadrowania:

Rozmywanie dalej zmniejsza rozmiar JPGa.

Najwyraźniej jest tu problem z definicją informacji w obrazach, no i stąd te bezsensowne próby i wnioski.

Tu masz 'realne' obrazy do wypróbowania:

http://hubblesite.org/images/gallery

ściągnij coś tam w full rozdzielczości, np. to:

http://hubblesite.org/image/4229/gallery

no i przetestuj co z tego wyjdzie po rozmyciu i kompresji (bezstratnej).

ściągnij coś tam w full rozdzielczości, np. to:

http://hubblesite.org/image/4229/galleryno i przetestuj co z tego wyjdzie po rozmyciu i kompresji (bezstratnej).

Rozmiary:

Po rozmyciu obraz jest ponad 1/3 mniejszy.

Faktyczne to się zmniejsza, a nie zwiększa - i tak ma być, uśrednianie jest zawsze stratne!

Pomyliło mi się już na początku, bo ja robiłem coś zupełnie innego:

podczas korygowania obrazów, zwykle takich marnej jakości - ze skanera,

najpierw to powiększałem np. 2x i teraz wygładzałem;

potem korygowałem kolory i z powrotem wyostrzałem i finalnie zmniejszałem do pierwotnych rozmiarów.

No i po tym wszystkim było to o niebo lepszej jakości, ale i większe po skompresowaniu.

Niekiedy jeszcze odejmowałem to wygładzone z oryginałem (tworząc niby maskę do korekty), co potem wymnażałem z oryginałem - wtedy to już było super ale i dużo większe!

A tak na marginesie, z tych prozaicznych obrazków z teleskopów można niekiedy wyciskać fantastyczne - ukryte informacje!

Tu jest przykład:

http://lempel.pagesperso-orange.fr/os_ponts_de_matiere_arp102_uk.htm

obraz oryginalny:

a po obróbce wygląda to tak:

czyli widać wyraźnie że te galaktyki są tam faktycznie powiązane - coś tam wyraźnie przepływa pomiędzy nimi.

Faktyczne to się zmniejsza, a nie zwiększa - i tak ma być, uśrednianie jest zawsze stratne!

Pomyliło mi się już na początku, bo ja robiłem coś zupełnie innego:

No i to jest świetne podsumowanie całego tego nielogicznego bredzenia.

Masz kolejny problem do rozwiązania: jaki jest limit tych strat informacji, z rozmycia, itp. aby obraz był nadal czytelny?

Chodzi mi o coś takiego z czym mamy do czynienia np. we mgle, lub gdy pada śnieg:

widoczność wtedy maleje z dystansem, aż do zera, tyle że w teorii to nigdy nie jest zerem,

ponieważ to idzie zgodnie z funkcją: exp(-x), co zeruje się dopiero w nieskończoności.

Zatem pytanie jest proste:

ile procent tej informacji wystarcza do zidentyfikowania znanych obiektów, jak np. latarnia na ulicy,

albo galaktyka na tych obrazkach z kosmosu - 1%, 5%, a może 10%?

Jest wideo tutorial o ANS:

I wykład z Berkeley (od 41 minuty):

Jest promocyjna animacja z UJ:

https://nauka.uj.edu.pl/aktualnosci/-/journal_content/56_INSTANCE_Sz8leL0jYQen/74541952/144376676

W której okazuje się że ANS będzie w zbliżającym się JPEG XL - głównie od Google, chyba ma szansę wyprzeć JPG, GIF, PNG:

https://www.spiedigitallibrary.org/conference-proceedings-of-spie/11137/2529237/JPEG-XL-next-generation-image-compression-architecture-and-coding-tools/10.1117/12.2529237.full?SSO=1

elenorf napisał(a):

W której okazuje się że ANS będzie w zbliżającym się JPEG XL - głównie od Google, chyba ma szansę wyprzeć JPG, GIF, PNG:

Co, znowu?

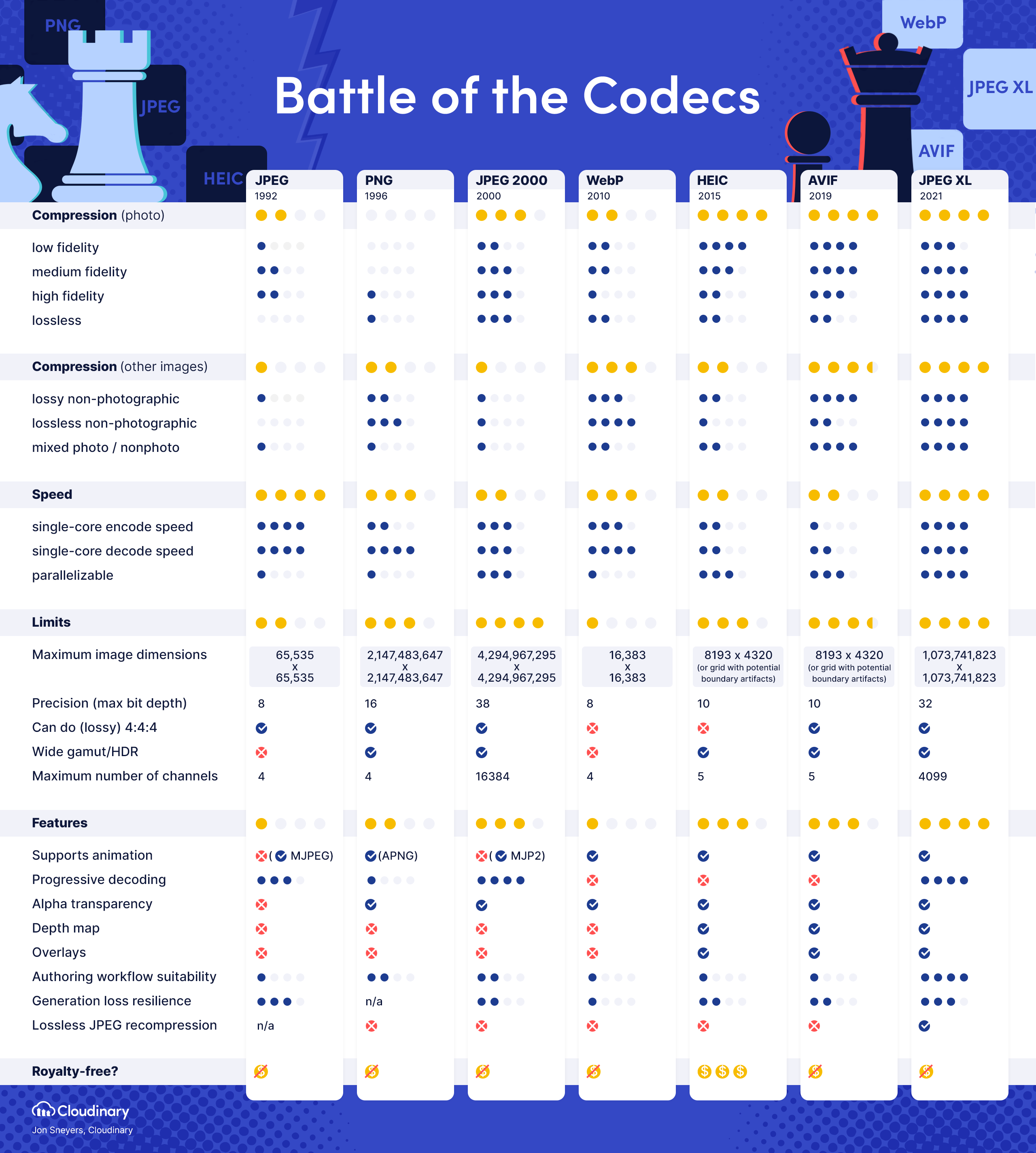

Już były wspaniałe wynalazki co miały wyprzeć - jakieś JPEG2000, jakieś WebP, jakieś HEIC...

Azarien napisał(a):

elenorf napisał(a):

W której okazuje się że ANS będzie w zbliżającym się JPEG XL - głównie od Google, chyba ma szansę wyprzeć JPG, GIF, PNG:

Co, znowu?

Już były wspaniałe wynalazki co miały wyprzeć - jakieś JPEG2000, jakieś WebP, jakieś HEIC...

Z tego artykułu z UJ ( https://nauka.uj.edu.pl/aktualnosci/-/journal_content/56_INSTANCE_Sz8leL0jYQen/74541952/144376676 ):

Będący na ukończeniu standard kompresji obrazu JPEG XL, głównie od Google:

Nawet 3-krotne zmniejszenie wielkości plików dla nowych zdjęć,Zmniejszenie starych plików JPG (np. zdjęć) o ok. 20% bez utraty jakości,Kompresja bezstratna - zastąpienie np. plików PNG, TIFF,Obsługa animacji (zastąpienie plików GIF), przeźroczystości, HDR (więcej kolorów),Progresywne dekodowanie, jeden plik dla różnych rozdzielczości.

Samo to " Zmniejszenie starych plików JPG (np. zdjęć) o ok. 20% bez utraty jakości," oraz firma sugeruje że niedługo stanie się to automatycznie ze starymi zdjęciami na wszystkich telefonach z Androidem.

Oczywiście czas pokaże, ale np. starym formatom brakuje wielu funkcjonalności, tutaj są stosowane najnowsze technologie jak ANS (lepsza kompresja rozsądna szybkość), opracowywany głównie przez duży zespół od Google - wygląda obiecująco.

JPEG2000 był niewypałem, HEIC ma sporo patentów, WebP jest od Google - pewnie do zastąpienia przez JPEG XL.

Dobry wykład jednego z autorów (i FLIFa):

Formaty stratnej kompresji danych opierają się na dwóch fazach:

O ile dobrze rozumiem zapewnienia o formacie JPEG XL to zmniejszenie plików JPEG po przekodowaniu do JPEG XL bez utraty jakości jest możliwe dzięki temu, że:

Po Google, teraz próba patentowania przez Microsoft: https://www.theregister.com/2021/03/13/microsoft_ans_patent/

JPEG XL już można włączyć m.in. w Chrome, Firefox, Edge https://en.wikipedia.org/wiki/JPEG_XL

Świeża dyskusja: https://news.ycombinator.com/item?id=27577328